Tópicos em alta

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

CodecFlow

Camada de execução para operadores de IA e robótica no @Solana

CA:69LjZUUzxj3Cb3Fxeo1X4QpYEQTboApkhXTysPpbpump

Os VLAs ainda são muito novos e muitas pessoas acham difícil entender a diferença entre VLAs e LLMs.

Aqui está um mergulho profundo em como esses sistemas de IA diferem em raciocínio, detecção e ação. Parte 1.

Vamos detalhar as principais distinções e como os agentes de IA envolvidos em um LLM diferem dos agentes operadores que usam modelos VLA:

1. Sentido: como eles percebem o mundo

Agente (LLM): processa texto ou dados estruturados, por exemplo, JSON, APIs e, às vezes, imagens. É como um cérebro trabalhando com entradas limpas e abstratas. Pense em ler um manual ou analisar uma planilha. Ótimo para ambientes estruturados, mas limitado pelo que é alimentado a ele.

Operador (VLA): Vê pixels brutos e em tempo real das câmeras, além de dados do sensor (por exemplo, toque, posição) e propriocepção (autoconsciência do movimento). É como navegar pelo mundo com olhos e sentidos, prosperando em ambientes dinâmicos e confusos, como interfaces de usuário ou espaços físicos.

2. Agir: como eles interagem

Agente: atua chamando funções, ferramentas ou APIs. Imagine isso como um gerente enviando instruções precisas como "reserve um voo via API da Expedia". É deliberado, mas depende de ferramentas pré-construídas e interfaces claras.

Operador: Executa ações contínuas e de baixo nível, como mover o cursor do mouse, digitar ou controlar as articulações do robô. É como um trabalhador qualificado manipulando diretamente o ambiente, ideal para tarefas que exigem precisão em tempo real.

3. Controle: como eles tomam decisões

Agente: Segue um ciclo lento e reflexivo: planejar, chamar uma ferramenta, avaliar o resultado, repetir. É vinculado a token (limitado por processamento de texto) e vinculado à rede (aguardando respostas da API). Isso o torna metódico, mas lento para tarefas em tempo real.

Operador: Opera, tomando decisões passo a passo em um ciclo de feedback apertado. Pense nisso como um jogador reagindo instantaneamente ao que está na tela. Essa velocidade permite a interação fluida, mas exige processamento robusto em tempo real.

4. Dados para aprender: o que alimenta seu treinamento

Agente: treinado em vastos corpora de texto, instruções, documentação ou conjuntos de dados RAG (Retrieval-Augmented Generation). Ele aprende com livros, códigos ou perguntas frequentes, destacando-se no raciocínio sobre o conhecimento estruturado.

Operador: Aprende com demonstrações (por exemplo, vídeos de humanos realizando tarefas), registros de teleoperação ou sinais de recompensa. É como aprender observando e praticando, perfeito para tarefas em que instruções explícitas são escassas.

5. Modos de falha: onde eles quebram

Agente: Propenso a alucinações (inventar respostas) ou planos frágeis de longo prazo que desmoronam se uma etapa falhar. É como um estrategista que pensa demais ou interpreta mal a situação.

Operador: enfrenta mudança de covariável (quando os dados de treinamento não correspondem às condições do mundo real) ou erros compostos no controle (pequenos erros bola de neve). É como um motorista perdendo o controle em uma estrada desconhecida.

6. Infra: A tecnologia por trás deles

Agente: depende de um prompt/roteador para decidir quais ferramentas chamar, um registro de ferramentas para funções disponíveis e memória/RAG para contexto. É uma configuração modular, como um centro de comando orquestrando tarefas.

Operador: precisa de pipelines de ingestão de vídeo, um servidor de ação para controle em tempo real, um escudo de segurança para evitar ações prejudiciais e um buffer de reprodução para armazenar experiências. É um sistema de alto desempenho criado para ambientes dinâmicos.

7. Onde cada um brilha: seus pontos ideais

Agente: domina fluxos de trabalho com APIs limpas (por exemplo, automatizando processos de negócios), raciocínio sobre documentos (por exemplo, resumindo relatórios) ou geração de código. É a sua escolha para tarefas estruturadas e de alto nível.

Operador: Destaca-se em ambientes confusos e sem API, como navegar em interfaces de usuário desajeitadas, controlar robôs ou lidar com tarefas semelhantes a jogos. Se envolver interação em tempo real com sistemas imprevisíveis, o VLA é rei.

8. Modelo Mental: Planejador + Fazedor

Pense no Agente LLM como o planejador: ele divide tarefas complexas em metas claras e lógicas.

O Operador VLA é o executor, executando essas metas interagindo diretamente com pixels ou sistemas físicos. Um verificador (outro sistema ou agente) monitora os resultados para garantir o sucesso.

$CODEC

1,2K

O Codecflow Optr oferece uma abordagem unificada para criar agentes que veem, raciocinam e agem em ambientes digitais e físicos. Seja automatizando fluxos de trabalho de desktop, controlando braços robóticos ou testando em simulação, ele usa o mesmo modelo mental e primitivos.

Louround 🥂21 de ago. de 2025

Dips in a bull market are meant to be bought, especially on projects with big catalysts

We all know that AI is the narrative of this cycle, started by ai16z and Virtuals last year.

My bet is that the market will focus on more complex and sophisticated technologies such as VLAs, and let me tell you why.

LLMs (Large Language Models) mainly read and write text: they’re great at explaining, planning, and generating instructions, but they don’t by themselves control motors or interact with the physical world (as you may have experienced with chatgpt).

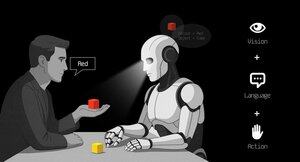

VLAs (Vision Language Action models) differ from LLMs as they are multimodal systems that look at things (vision), understand instructions (language), and directly produce actions. It's like telling a robot to pick up a red cup and then moving its arm to do it.

VLAs are trained on examples that pair images/video + instructions + real action traces (how a robot actually moved), and they must run fast and safely in real time. LLMs on their side are trained on huge text collections and focus on reasoning and language tasks.

TL;DR LLMs think and speak whil VLAs see, reason, and act.

As you can see, VLAs are a major addition to LLMs and will notably enable the next 0 to 1 innovation in the overall economy that will be robotics. A majority of investment funds are allocating a large part of their investments into this sector, seen as the next logical evolution in the AI industry.

I already made a post a while ago on the current leader in the crypto market, @codecopenflow, which did not raise capital (fair launch) yet is shipping cutting-edge products and currently sitting at $23M FDV.

For information, other crypto competitors raised $20m ( @openmind_agi) at what is probably a $200M to $300M ++ FDV while no product or community has been built and shipped yet.

What makes Codec a leading project in the sector is that they tackle a crucial bottleneck in robotics and AI, which is the difficulty to have all the AI tools interact together. Let me explain.

Their latest release, OPTR (operator), is a toolkit that helps build operators capable of interacting on multiple platforms such as robots, desktops, browsers, or simulations. The objective of an operator is to see, reason, and act (VLA) in both digital (computers) and physical (robots) worlds.

This toolkit serves as core infrastructure for robotic teams aiming to test their product and enhance the overall process by providing a unified experience instead of separate ones for web browsers, simulations, or robots. This essentially makes the operator adaptive and autonomous regardless of its environment.

So you get it, it will save big time for companies and developers who previously had to go through each step manually and where you can save time you can save money.

It will also enable Codec to build their own operator projects and launch new capacities relatively fast onto the market, notably through their marketplace.

TL;DR: You probably have seen videos of robots folding tissues, sorting boxes, or jumping on various elements. They have all been trained for this very specific use case, and unfortunately, one skill cannot be re-used in another environment like a human could do. OPTR from Codec solves this by making skills transferrable among environments and situations, making training and development a lot faster and cheaper for enterprises.

This is why Codec is so interesting in unifying the digital world with the physical world.

$CODEC, Coded.

1,18K

A empresa de pesquisa @epochbiz (por @ZoomerOracle) publicou uma pesquisa detalhada sobre o CodecFlow.

Não perca.

$CODEC

epoch_19 de ago. de 2025

$CODEC está se configurando para ser a melhor opção como jogo onchain para robótica

Artigo de pesquisa sobre @codecopenflow já está disponível em 🤖

1,22K

Melhores

Classificação

Favoritos