Chủ đề thịnh hành

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

CodecFlow

Lớp thực thi cho Người vận hành AI và Robot trên @Solana

CA:69LjZUUzxj3Cb3Fxeo1X4QpYEQTboApkhXTysPpbpump

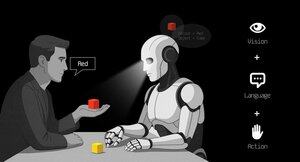

VLAs vẫn còn rất mới và nhiều người thấy khó khăn trong việc hiểu sự khác biệt giữa VLAs và LLMs.

Dưới đây là một cái nhìn sâu sắc về cách mà các hệ thống AI này khác nhau trong lý luận, cảm nhận và hành động. Phần 1.

Hãy phân tích những điểm khác biệt chính và cách mà các tác nhân AI được bao quanh bởi một LLM khác với các tác nhân điều hành sử dụng mô hình VLA:

1. Cảm nhận: Cách họ cảm nhận thế giới

Tác nhân (LLM): Xử lý văn bản hoặc dữ liệu có cấu trúc như JSON, API, và đôi khi là hình ảnh. Nó giống như một bộ não làm việc với các đầu vào sạch sẽ, trừu tượng. Hãy nghĩ đến việc đọc một hướng dẫn hoặc phân tích một bảng tính. Tuyệt vời cho các môi trường có cấu trúc nhưng bị giới hạn bởi những gì được cung cấp cho nó.

Điều hành (VLA): Nhìn thấy các pixel thô, thời gian thực từ camera, cộng với dữ liệu cảm biến (ví dụ: cảm ứng, vị trí) và cảm giác vị trí (nhận thức về chuyển động). Nó giống như việc điều hướng thế giới bằng mắt và các giác quan, phát triển trong các môi trường động, lộn xộn như giao diện người dùng hoặc không gian vật lý.

2. Hành động: Cách họ tương tác

Tác nhân: Hành động bằng cách gọi các hàm, công cụ hoặc API. Hãy tưởng tượng nó như một người quản lý gửi các chỉ dẫn chính xác như "đặt vé máy bay qua API Expedia." Nó có chủ đích nhưng phụ thuộc vào các công cụ đã được xây dựng sẵn và các giao diện rõ ràng.

Điều hành: Thực hiện các hành động liên tục, cấp thấp, như di chuyển con trỏ chuột, gõ, hoặc điều khiển các khớp robot. Nó giống như một công nhân lành nghề trực tiếp thao tác môi trường, lý tưởng cho các nhiệm vụ yêu cầu độ chính xác theo thời gian thực.

3. Kiểm soát: Cách họ đưa ra quyết định

Tác nhân: Theo một vòng lặp chậm, phản ánh: lập kế hoạch, gọi một công cụ, đánh giá kết quả, lặp lại. Nó bị ràng buộc bởi token (bị giới hạn bởi xử lý văn bản) và bị ràng buộc bởi mạng (chờ phản hồi từ API). Điều này làm cho nó có phương pháp nhưng chậm chạp cho các nhiệm vụ theo thời gian thực.

Điều hành: Hoạt động, đưa ra các quyết định từng bước trong một vòng phản hồi chặt chẽ. Hãy nghĩ về nó như một game thủ phản ứng ngay lập tức với những gì trên màn hình. Tốc độ này cho phép tương tác linh hoạt nhưng đòi hỏi xử lý thời gian thực mạnh mẽ.

4. Dữ liệu để học: Điều gì thúc đẩy việc đào tạo của họ

Tác nhân: Được đào tạo trên các tập dữ liệu văn bản khổng lồ, hướng dẫn, tài liệu, hoặc RAG (Tạo ra Tăng cường Tìm kiếm). Nó học từ sách, mã, hoặc các câu hỏi thường gặp, xuất sắc trong việc lý luận trên kiến thức có cấu trúc.

Điều hành: Học từ các minh họa (ví dụ: video của con người thực hiện các nhiệm vụ), nhật ký điều khiển từ xa, hoặc tín hiệu thưởng. Nó giống như học bằng cách quan sát và thực hành, hoàn hảo cho các nhiệm vụ mà hướng dẫn rõ ràng hiếm khi có.

5. Chế độ thất bại: Nơi họ gặp trục trặc

Tác nhân: Dễ bị ảo giác (tạo ra câu trả lời) hoặc kế hoạch dài hạn dễ gãy nếu một bước thất bại. Nó giống như một chiến lược gia suy nghĩ quá nhiều hoặc hiểu sai tình huống.

Điều hành: Đối mặt với sự thay đổi đồng biến (khi dữ liệu đào tạo không khớp với điều kiện thực tế) hoặc lỗi tích lũy trong kiểm soát (những sai lầm nhỏ tích tụ). Nó giống như một tài xế mất kiểm soát trên một con đường không quen thuộc.

6. Hạ tầng: Công nghệ đứng sau họ

Tác nhân: Dựa vào một prompt/router để quyết định công cụ nào để gọi, một danh sách công cụ cho các chức năng có sẵn, và bộ nhớ/RAG cho ngữ cảnh. Nó là một thiết lập mô-đun, giống như một trung tâm chỉ huy điều phối các nhiệm vụ.

Điều hành: Cần các đường ống tiếp nhận video, một máy chủ hành động cho kiểm soát thời gian thực, một lá chắn an toàn để ngăn chặn các hành động có hại, và một bộ đệm phát lại để lưu trữ kinh nghiệm. Nó là một hệ thống hiệu suất cao được xây dựng cho các môi trường động.

7. Nơi mỗi cái tỏa sáng: Điểm mạnh của họ

Tác nhân: Chiếm ưu thế trong các quy trình làm việc với API sạch (ví dụ: tự động hóa quy trình kinh doanh), lý luận trên tài liệu (ví dụ: tóm tắt báo cáo), hoặc tạo mã. Nó là lựa chọn của bạn cho các nhiệm vụ có cấu trúc, cấp cao.

Điều hành: Xuất sắc trong các môi trường lộn xộn, không có API như điều hướng các giao diện người dùng cồng kềnh, điều khiển robot, hoặc giải quyết các nhiệm vụ giống như trò chơi. Nếu nó liên quan đến tương tác thời gian thực với các hệ thống không thể đoán trước, VLA là vua.

8. Mô hình tâm lý: Người lập kế hoạch + Người thực hiện

Hãy nghĩ về Tác nhân LLM như là người lập kế hoạch: nó phân chia các nhiệm vụ phức tạp thành các mục tiêu rõ ràng, logic.

Điều hành VLA là người thực hiện, thực hiện những mục tiêu đó bằng cách tương tác trực tiếp với các pixel hoặc hệ thống vật lý. Một người kiểm tra (một hệ thống hoặc tác nhân khác) giám sát kết quả để đảm bảo thành công.

$CODEC

1,19K

Codecflow Optr cung cấp một cách tiếp cận thống nhất để xây dựng các tác nhân có khả năng nhìn, lý luận và hành động trong các môi trường kỹ thuật số và vật lý. Dù là tự động hóa quy trình làm việc trên máy tính để bàn, điều khiển cánh tay robot, hay thử nghiệm trong mô phỏng, nó sử dụng cùng một mô hình tư duy và các nguyên lý cơ bản.

Louround 🥂21 thg 8, 2025

Dips in a bull market are meant to be bought, especially on projects with big catalysts

We all know that AI is the narrative of this cycle, started by ai16z and Virtuals last year.

My bet is that the market will focus on more complex and sophisticated technologies such as VLAs, and let me tell you why.

LLMs (Large Language Models) mainly read and write text: they’re great at explaining, planning, and generating instructions, but they don’t by themselves control motors or interact with the physical world (as you may have experienced with chatgpt).

VLAs (Vision Language Action models) differ from LLMs as they are multimodal systems that look at things (vision), understand instructions (language), and directly produce actions. It's like telling a robot to pick up a red cup and then moving its arm to do it.

VLAs are trained on examples that pair images/video + instructions + real action traces (how a robot actually moved), and they must run fast and safely in real time. LLMs on their side are trained on huge text collections and focus on reasoning and language tasks.

TL;DR LLMs think and speak whil VLAs see, reason, and act.

As you can see, VLAs are a major addition to LLMs and will notably enable the next 0 to 1 innovation in the overall economy that will be robotics. A majority of investment funds are allocating a large part of their investments into this sector, seen as the next logical evolution in the AI industry.

I already made a post a while ago on the current leader in the crypto market, @codecopenflow, which did not raise capital (fair launch) yet is shipping cutting-edge products and currently sitting at $23M FDV.

For information, other crypto competitors raised $20m ( @openmind_agi) at what is probably a $200M to $300M ++ FDV while no product or community has been built and shipped yet.

What makes Codec a leading project in the sector is that they tackle a crucial bottleneck in robotics and AI, which is the difficulty to have all the AI tools interact together. Let me explain.

Their latest release, OPTR (operator), is a toolkit that helps build operators capable of interacting on multiple platforms such as robots, desktops, browsers, or simulations. The objective of an operator is to see, reason, and act (VLA) in both digital (computers) and physical (robots) worlds.

This toolkit serves as core infrastructure for robotic teams aiming to test their product and enhance the overall process by providing a unified experience instead of separate ones for web browsers, simulations, or robots. This essentially makes the operator adaptive and autonomous regardless of its environment.

So you get it, it will save big time for companies and developers who previously had to go through each step manually and where you can save time you can save money.

It will also enable Codec to build their own operator projects and launch new capacities relatively fast onto the market, notably through their marketplace.

TL;DR: You probably have seen videos of robots folding tissues, sorting boxes, or jumping on various elements. They have all been trained for this very specific use case, and unfortunately, one skill cannot be re-used in another environment like a human could do. OPTR from Codec solves this by making skills transferrable among environments and situations, making training and development a lot faster and cheaper for enterprises.

This is why Codec is so interesting in unifying the digital world with the physical world.

$CODEC, Coded.

1,17K

Công ty nghiên cứu @epochbiz (bởi @ZoomerOracle) đã công bố một bài nghiên cứu chi tiết về CodecFlow.

Đừng bỏ lỡ nó.

$CODEC

epoch_19 thg 8, 2025

$CODEC đang chuẩn bị trở thành lựa chọn tốt nhất cho trò chơi onchain trong Robotics

Bài nghiên cứu về @codecopenflow hiện đã được công bố trên 🤖

1,21K

Hàng đầu

Thứ hạng

Yêu thích