Trendaavat aiheet

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

CodecFlow

Toteutuskerros tekoälyoperaattoreille ja robotiikalle @Solana

CA:69LjZUUzxj3Cb3Fxeo1X4QpYEQTboApkhXTysPpbpump

VLA:t ovat vielä hyvin uusia, ja monien ihmisten on vaikea ymmärtää eroa VLA:n ja LLM:n välillä.

Tässä on syväsukellus siihen, miten nämä tekoälyjärjestelmät eroavat toisistaan päättelyssä, aistimisessa ja toiminnassa. Osa 1.

Tarkastellaan keskeisiä eroja ja sitä, miten LLM:n ympärille käärityt tekoälyagentit eroavat VLA-malleja käyttävistä operaattoriagenteista:

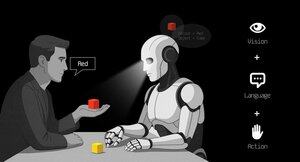

1. Aisti: Miten he näkevät maailman

Agentti (LLM): Käsittelee tekstiä tai strukturoitua dataa, kuten JSONia, API:ita ja joskus kuvia. Se on kuin aivot, jotka työskentelevät puhtaiden, abstraktien syötteiden kanssa. Ajattele käsikirjan lukemista tai laskentataulukon jäsentämistä. Sopii erinomaisesti jäsenneltyihin ympäristöihin, mutta sitä rajoittaa se, mitä siihen syötetään.

Operaattori (VLA): Näkee kameroiden raa'at, reaaliaikaiset pikselit sekä anturitiedot (esim. kosketus, sijainti) ja proprioseption (liikkeen itsetietoisuus). Se on kuin navigoisi maailmassa silmin ja aistein ja kukoistaisi dynaamisissa, sotkuisissa ympäristöissä, kuten käyttöliittymässä tai fyysisissä tiloissa.

2. Toimi: Kuinka he ovat vuorovaikutuksessa

Agentti: Toimii kutsumalla funktioita, työkaluja tai ohjelmointirajapintoja. Kuvittele se johtajana, joka lähettää tarkkoja ohjeita, kuten "varaa lento Expedia API:n kautta". Se on tarkoituksellista, mutta perustuu valmiisiin työkaluihin ja selkeisiin käyttöliittymiin.

Operaattori: Suorittaa jatkuvia, matalan tason toimintoja, kuten hiiren osoittimen liikuttamista, kirjoittamista tai robottinivelten ohjaamista. Se on kuin taitava työntekijä, joka manipuloi suoraan ympäristöä, ihanteellinen reaaliaikaista tarkkuutta vaativiin tehtäviin.

3. Hallinta: Kuinka he tekevät päätöksiä

Agentti: Seuraa hidasta, pohdiskelevaa silmukkaa: suunnittele, kutsu työkalua, arvioi tulos, toista. Se on token-sidottu (tekstinkäsittelyn rajoittama) ja verkkoon sidottu (odottaa API-vastauksia). Tämä tekee siitä järjestelmällisen, mutta hitaan reaaliaikaisissa tehtävissä.

Käyttäjä: Toimii ja tekee vaiheittaisia päätöksiä tiukassa palautesilmukassa. Ajattele sitä kuin pelaaja, joka reagoi välittömästi siihen, mitä ruudulla on. Tämä nopeus mahdollistaa nesteen vuorovaikutuksen, mutta vaatii vankkaa reaaliaikaista käsittelyä.

4. Opittava data: Mikä ruokkii heidän koulutustaan

Agentti: Koulutettu laajoihin tekstikorpuksiin, ohjeisiin, dokumentaatioon tai RAG-tietojoukkoihin (Retrieval-Augmented Generation). Se oppii kirjoista, koodista tai usein kysytyistä kysymyksistä ja on erinomainen päättelyssä jäsennellyn tiedon sijaan.

Operaattori: Oppii demonstraatioista (esim. videot ihmisistä suorittamassa tehtäviä), etäkäyttölokeista tai palkitsemissignaaleista. Se on kuin oppimista katsomalla ja harjoittelemalla, täydellinen tehtäviin, joissa selkeät ohjeet ovat niukkoja.

5. Vikatilat: Missä ne rikkoutuvat

Agentti: Altis hallusinaatioille (vastausten keksimiselle) tai hauraille pitkän horisontin suunnitelmille, jotka hajoavat, jos yksi askel epäonnistuu. Se on kuin strategi, joka ajattelee liikaa tai tulkitsee tilanteen väärin.

Operaattori: Kohtaa kovariaattisen siirtymän (kun harjoitustiedot eivät vastaa todellisia olosuhteita) tai yhdistelmävirheitä ohjauksessa (pienet virheet lumipallo). Se on kuin kuljettaja menettäisi hallinnan tuntemattomalla tiellä.

6. Infra: Teknologia niiden takana

Agentti: Käyttää kehotetta/reititintä päättääkseen, mitä työkaluja kutsutaan, työkalurekisteriin käytettävissä oleville funktioille ja muistiin/RAG:iin kontekstin saamiseksi. Se on modulaarinen kokoonpano, kuten komentokeskus, joka orkestroi tehtäviä.

Operaattori: Tarvitsee videon käsittelyputkia, toimintopalvelimen reaaliaikaista hallintaa varten, turvasuojan haitallisten toimintojen estämiseksi ja toistopuskurin kokemusten tallentamista varten. Se on tehokas järjestelmä, joka on rakennettu dynaamisiin ympäristöihin.

7. Missä kukin loistaa: Heidän makeat paikkansa

Agentti: Hallitsee työnkulkuja, joissa on puhtaat sovellusliittymät (esim. liiketoimintaprosessien automatisointi), asiakirjojen päättely (esim. raporttien yhteenveto) tai koodin luominen. Se on sinun valintasi jäsenneltyihin, korkean tason tehtäviin.

Operaattori: Toimii erinomaisesti sotkuisissa, API-rajattomissa ympäristöissä, kuten kömpelöissä käyttöliittymissä navigoinnissa, robottien ohjaamisessa tai pelimäisten tehtävien suorittamisessa. Jos siihen liittyy reaaliaikaista vuorovaikutusta arvaamattomien järjestelmien kanssa, VLA on kuningas.

8. Henkinen malli: Suunnittelija + tekijä

Ajattele LLM-agenttia suunnittelijana: se jakaa monimutkaiset tehtävät selkeiksi, loogisiksi tavoitteiksi.

VLA-operaattori on tekijä, joka toteuttaa nämä tavoitteet suorassa vuorovaikutuksessa pikselien tai fyysisten järjestelmien kanssa. Tarkistaja (toinen järjestelmä tai agentti) seuraa tuloksia onnistumisen varmistamiseksi.

$CODEC

1,2K

Codecflow Optr tarjoaa yhtenäisen lähestymistavan rakennusagentteihin, jotka näkevät, järkeilevät ja toimivat digitaalisissa ja fyysisissä ympäristöissä. Olipa kyse sitten työpöydän työnkulkujen automatisoinnista, robottikäsien ohjaamisesta tai simulaatiotestauksesta, se käyttää samaa mentaalista mallia ja primitiiviä.

Louround 🥂21.8.2025

Dips in a bull market are meant to be bought, especially on projects with big catalysts

We all know that AI is the narrative of this cycle, started by ai16z and Virtuals last year.

My bet is that the market will focus on more complex and sophisticated technologies such as VLAs, and let me tell you why.

LLMs (Large Language Models) mainly read and write text: they’re great at explaining, planning, and generating instructions, but they don’t by themselves control motors or interact with the physical world (as you may have experienced with chatgpt).

VLAs (Vision Language Action models) differ from LLMs as they are multimodal systems that look at things (vision), understand instructions (language), and directly produce actions. It's like telling a robot to pick up a red cup and then moving its arm to do it.

VLAs are trained on examples that pair images/video + instructions + real action traces (how a robot actually moved), and they must run fast and safely in real time. LLMs on their side are trained on huge text collections and focus on reasoning and language tasks.

TL;DR LLMs think and speak whil VLAs see, reason, and act.

As you can see, VLAs are a major addition to LLMs and will notably enable the next 0 to 1 innovation in the overall economy that will be robotics. A majority of investment funds are allocating a large part of their investments into this sector, seen as the next logical evolution in the AI industry.

I already made a post a while ago on the current leader in the crypto market, @codecopenflow, which did not raise capital (fair launch) yet is shipping cutting-edge products and currently sitting at $23M FDV.

For information, other crypto competitors raised $20m ( @openmind_agi) at what is probably a $200M to $300M ++ FDV while no product or community has been built and shipped yet.

What makes Codec a leading project in the sector is that they tackle a crucial bottleneck in robotics and AI, which is the difficulty to have all the AI tools interact together. Let me explain.

Their latest release, OPTR (operator), is a toolkit that helps build operators capable of interacting on multiple platforms such as robots, desktops, browsers, or simulations. The objective of an operator is to see, reason, and act (VLA) in both digital (computers) and physical (robots) worlds.

This toolkit serves as core infrastructure for robotic teams aiming to test their product and enhance the overall process by providing a unified experience instead of separate ones for web browsers, simulations, or robots. This essentially makes the operator adaptive and autonomous regardless of its environment.

So you get it, it will save big time for companies and developers who previously had to go through each step manually and where you can save time you can save money.

It will also enable Codec to build their own operator projects and launch new capacities relatively fast onto the market, notably through their marketplace.

TL;DR: You probably have seen videos of robots folding tissues, sorting boxes, or jumping on various elements. They have all been trained for this very specific use case, and unfortunately, one skill cannot be re-used in another environment like a human could do. OPTR from Codec solves this by making skills transferrable among environments and situations, making training and development a lot faster and cheaper for enterprises.

This is why Codec is so interesting in unifying the digital world with the physical world.

$CODEC, Coded.

1,18K

Tutkimusyhtiö @epochbiz (kirjoittanut @ZoomerOracle) julkaisi yksityiskohtaisen tutkimuksen CodecFlow'sta.

Älä missaa sitä.

$CODEC

epoch_19.8.2025

$CODEC on tulossa parhaaksi vaihtoehdoksi robotiikan ketjussa pelattavaksi

Tutkimusartikkeli @codecopenflow on nyt julkaistu 🤖

1,22K

Johtavat

Rankkaus

Suosikit