トレンドトピック

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

実際、今回は違います。LLM を単なる「次のトークン予測因子」として却下することは、脳を単なる「電気化学的シグナル伝達を行うニューロンの集まり」と表現するのと同じくらい愚かで還元的です。

最も説得力のある証拠は、モダリティを超えた極端な普遍性です。

9月27日 22:43

しかし、Transformerアーキテクチャは、適切なレベルの一般性と表現力を備えたユニバーサルジェネリックコンピューターの最初の完全に微分可能なチューリング完全抽象化であり、私たちはついにそれらをトレーニングし、それをすべて行うためのFLOPSとデータを手に入れるためのトリックを見つけました。

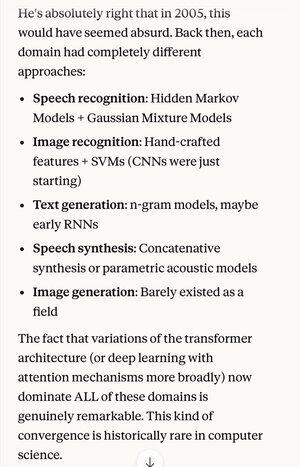

2005年に誰かが、今から20年後、音声認識アルゴリズムの絶対的な最先端は、最高の画像認識アルゴリズムと同じ基本システム(注意を備えたディープニューラルネット)であると言ったとしたら...

…これは、たまたま最高の自然言語テキスト生成、最高の音声合成、最高の画像生成などと同じであったため、おそらく統合失調症であるか、少なくともナンセンスなことをしていると思うでしょう。なぜなら、それらの領域にはそれぞれ独自のテクニックがあったからです。

科学的方法、そして一般的な合理的思考における重要な概念の1つは、あなたが投入したよりもはるかに多くのものを得る、極端な倹約を示す説明と理論を強く優先することです。マクスウェルの4つの方程式が何百もの異なることを説明しているように。

物理学以外では、小さなことからこれほど多くのことを行うことができる単一のメカニズムやシステムのこれ以上の例を思いつくのは難しいです。

この複雑さをすべて、1つの統一的な概念に置き換えること(これはたまたま、人間の脳の働きに理想的な形でよく似ています)...

5.31K

トップ

ランキング

お気に入り